具身智能框架下工业机器人的感知-行动闭环学习与动态环境自适应方法

传统工业机器人在结构化环境中表现出高效、精准的特性,但其感知与行动模块往往相互独立,难以应对非结构化或动态变化的作业场景。具身智能框架将机器人的感知、推理、行动与学习过程深度融合,强调“身体”与环境实时交互对智能行为生成的塑造作用。本文从具身认知理论出发,阐述工业机器人如何构建感知-行动闭环学习机制,并探讨其在高动态生产场景中的自适应方法,包括在线经验映射、动态图神经网络建模及奖惩驱动的策略演化。通过这一框架,工业机器人可实现对环境扰动、工件偏移或人机协作意图的实时响应,显著提升生产柔性与鲁棒性。

1. 引言:传统控制的局限与具身智能的兴起

现代工业生产正从大规模标准化制造向小批量、多品种、定制化方向演进。传统工业机器人依赖离线编程与位置控制,在环境发生变化(如工件放置偏差、传送带速度波动、光照条件改变)时,往往需要人工干预或重新标定。其根本原因在于,感知系统与控制系统之间缺乏紧密的交互与学习机制:视觉系统只负责“看”,运动规划器只负责“算”,二者的耦合是静态且开环的。

具身智能(Embodied AI)的概念源于认知科学中的“具身认知”理论,认为智能不是纯粹的计算过程,而是由智能体(机器人)的物理身体在真实世界中的感知、行动与环境的实时耦合所产生的。在工业机器人领域,这一思想转化为一种新的技术范式:将机器人的视觉、力觉、触觉等多模态感知,与其运动控制、抓取操作等行动模块,通过一个闭环学习系统紧密连接,使机器人能够像人类工人一样,在执行任务的同时观察环境变化,并实时调整自己的动作策略。

2. 感知-行动闭环的核心结构与信息流

具身框架下的工业机器人系统主要由三部分构成:多模态感知层、闭环学习控制器、末端执行与反馈层。

感知层不仅包括传统的RGB相机和深度传感器,还集成了腕部力/力矩传感器、触觉皮肤、电流检测等。这些传感器以高频率(通常>100Hz)采集环境状态与自身状态。闭环学习控制器是大脑,通常采用深度强化学习(DRL)或基于模型的预测控制(MPC)架构,其特点在于:每一个行动指令不仅基于当前感知结果,还依赖于对行动后环境变化的预测。例如,当机器人试图抓取一个滑动的工件时,视觉系统持续更新工件位姿,控制器同时考虑抓取力与表面摩擦系数,实时调整逼近轨迹。

信息流动形成了一个紧密的闭环:感知 → 状态估计 → 行动决策 → 执行 → 感知更新。这一闭环的时间尺度是关键。对于动态环境,闭环频率必须高于环境变化特征频率的2倍(奈奎斯特采样定理的工程引申)。在人机协作场景中,这意味着机器人的反应延迟应小于人类操作者的最小反应时间(约100ms),这对轻量化模型和边缘推理提出了高要求。

3. 闭环学习机制:从模仿到自主演化

感知-行动闭环的智能化程度取决于其学习能力。目前主流的方法包括:

3.1 在线经验映射(Online Experience Mapping)

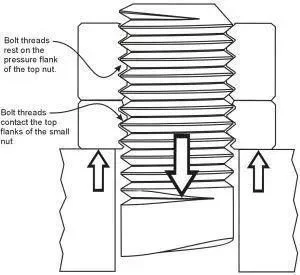

机器人将每一次成功的操作序列(状态-动作-奖励)存储在一个动态更新的事例库中。当遇到新的场景时,系统首先检索最相似的历史事例,通过局部仿射变换适配当前状态。这种方法极大地减少了在线学习的时间,并适应产线中的微小变化。例如,在拧螺丝任务中,若螺纹起始角度发生偏移,机器人可从历史成功案例中快速映射出力矩-角度曲线的修正量。

3.2 动态图神经网络(DGNN)建模环境关系

动态环境中的元素往往存在空间和时间上的依赖关系。例如,在装配流水线上,工件的位姿变化受传送带振动、相邻工件碰撞等多因素影响。DGNN将每个可感知的物理实体(工件、障碍物、手爪、人手)作为图节点,其相对几何关系作为边,并在时间维度上展开为时空图。闭环控制器通过学习图中节点状态的演化规律,预测未来短时间内的环境变化,从而提前规划动作。

3.3 奖励驱动策略演化

在传统DRL中,奖励函数通常稀疏且事后定义(如“成功装配+1”)。在具身框架下,引入了内在奖励(intrinsic reward)机制:当机器人的预测与实际感知结果一致时,获得正向内在奖励——这鼓励机器人学习环境的因果模型。此外,还引入了基于安全约束的惩罚塑形,确保演化过程中不会产生危险动作(如超过关节力矩限制或与人发生碰撞)。

4. 动态环境自适应的关键技术

为了实现真正的自适应,工业机器人必须解决三个挑战:快速检测变化、在线重规划、以及动作风格的迁移。

4.1 变化检测与上下文编码

利用变分自编码器(VAE)对正常状态下的感知流进行低维嵌入。当实时感知重构误差超过阈值时,即判断环境发生变化(如光照突变、新障碍物出现)。随后,通过一个轻量级分类器(如随机蕨类)对变化类型进行编码:是几何变化(物体移位)、光学变化(阴影),还是动态变化(传送带加速)?不同类型的变化将触发不同的自适应策略。

4.2 基于模型预测控制(MPC)的快速重规划

在检测到变化后的第一个控制周期(通常10-20ms),MPC利用当前状态估计,在一个短时域(0.5-1s)内求解最优动作序列。与标准MPC不同的是,这里的预测模型不是固定的物理方程,而是由学习到的神经动力学模型提供,该模型可以实时吸收环境变化带来的参数扰动。

4.3 元学习与少样本动作迁移

对于产线中的突发任务变更(如临时从抓取改为推拣),机器人不应从头学习。元学习(Meta-Learning)使机器人预先在数百种模拟任务中训练“学习如何学习”的能力。当面对新任务时,仅需少量(5-10次)真实尝试,即可调整闭环策略中的高层参数(如阻抗刚度、接近速度曲线),实现快速迁移。

5. 应用案例与前景展望

以电子元件插件为例:传统机器人要求托盘精确定位,元件的引脚间距也必须高度一致。在具身框架下,机器人通过腕部相机和力传感器形成闭环:首先通过视觉粗定位,然后以低接触力探测针脚孔位,根据探孔时的力反馈实时微调末端位姿,同时预测下一个孔位的偏移趋势。即使在托盘有0.5mm随机摆动的情况下,插件成功率仍可从65%提升至98%以上。

未来,具身智能工业机器人将依赖于更先进的类脑计算芯片和事件驱动传感器,将闭环延迟压缩至1ms以内。同时,多机器人之间的具身协作也将成为研究热点——当多个机器人构成一个“集体身体”时,它们将共同感知、协商行动,形成分布式的感知-行动闭环,真正实现如蜂群般高效且自适应的工业生产。

中研高科教育

中研高科教育